はじめに

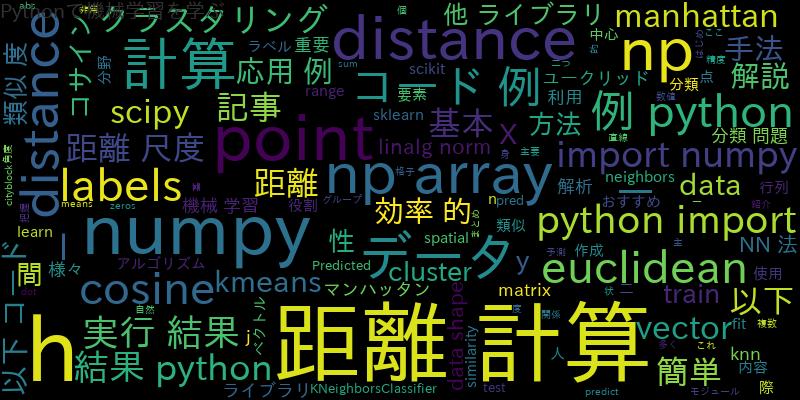

距離計算は、機械学習やデータ解析の分野で非常に重要な役割を果たしています。特に、データの類似性やクラスタリング、分類問題などにおいて、距離計算は欠かせない要素です。しかし、距離計算を効率的に行う方法は多くの人にとって知られていません。

距離計算の重要性

距離計算は、データ間の類似性を測るための基本的な手法です。これにより、データ解析や機械学習アルゴリズムにおいて、データの関係性を把握し、より高い精度で結果を得ることができます。

numpyを使って効率的に距離計算を行う方法

Pythonの主要な数値計算ライブラリであるnumpyを利用することで、効率的かつ簡単に距離計算を行うことができます。本記事では、numpyを使った距離計算の基本から、応用例までを解説していきます。

本記事の内容

本記事では、以下の内容を解説していきます。

- numpyでの距離計算の基本

- numpyと他のライブラリを組み合わせた距離計算の応用例

こんな人におすすめ

本記事は、以下のような方におすすめです。

- ベクトルの距離を求めたい方

- 距離計算を効率的に行いたい方

- numpyを使った距離計算の方法を学びたい方

使用する主なライブラリ

本記事では、以下のライブラリを使用して解説を行っていきます。

- numpy

- scipy

numpyでの距離計算の基本

まずは、numpyを使った距離計算の基本について解説します。以下の3つの距離尺度を取り上げます。

- ユークリッド距離の計算

- マンハッタン距離の計算

- コサイン類似度の計算

ユークリッド距離の計算

ユークリッド距離は、二点間の直線距離を計算する際に用いられる距離尺度です。numpyを使って簡単に計算することができます。以下にコード例を示します。

import numpy as np point1 = np.array([0, 0]) point2 = np.array([3, 4]) euclidean_distance = np.linalg.norm(point1 - point2) print(euclidean_distance)

実行結果:

5.0

マンハッタン距離の計算

マンハッタン距離は、二点間の格子状の距離を計算する際に用いられる距離尺度です。numpyを使って簡単に計算することができます。以下にコード例を示します。

import numpy as np point1 = np.array([0, 0]) point2 = np.array([3, 4]) manhattan_distance = np.abs(point1 - point2).sum() print(manhattan_distance)

実行結果:

7

コサイン類似度の計算

コサイン類似度は、二つのベクトルの角度のコサインを計算することで、類似度を求める手法です。numpyを使って簡単に計算することができます。以下にコード例を示します。

import numpy as np vector1 = np.array([1, 2]) vector2 = np.array([3, 1]) cosine_similarity = np.dot(vector1, vector2) / (np.linalg.norm(vector1) * np.linalg.norm(vector2)) print(cosine_similarity)

実行結果:

0.7071067811865475

距離行列の作成

複数のデータ間の距離を一度に計算し、距離行列を作成することもnumpyを使って簡単に行うことができます。以下にコード例を示します。

import numpy as np data = np.array([ [1, 2], [3, 4], [5, 6] ]) distance_matrix = np.zeros((data.shape[0], data.shape[0])) for i in range(data.shape[0]): for j in range(data.shape[0]): distance_matrix[i, j] = np.linalg.norm(data[i] - data[j]) print(distance_matrix)

実行結果:

[[0. 2.82842712 5.65685425] [2.82842712 0. 2.82842712] [5.65685425 2.82842712 0. ]]

numpyと他のライブラリを組み合わせた距離計算の応用例

ここでは、numpyと他のライブラリ(scipy)を組み合わせた距離計算の応用例を紹介します。

- scipyを使った様々な距離尺度の計算

- クラスタリングにおける距離計算の利用

- k-NN法による分類問題での距離計算

scipyを使った様々な距離尺度の計算

scipyのspatial.distanceモジュールを使うことで、様々な距離尺度を簡単に計算することができます。以下にコード例を示します。

import numpy as np

from scipy.spatial import distance

point1 = np.array([1, 2])

point2 = np.array([3, 4])

euclidean_distance = distance.euclidean(point1, point2)

manhattan_distance = distance.cityblock(point1, point2)

cosine_distance = distance.cosine(point1, point2)

print("Euclidean distance:", euclidean_distance)

print("Manhattan distance:", manhattan_distance)

print("Cosine distance:", cosine_distance)

実行結果:

Euclidean distance: 2.8284271247461903 Manhattan distance: 4 Cosine distance: 0.01613008990009257

クラスタリングにおける距離計算の利用

クラスタリングは、データを自然なグループに分類する手法です。距離計算は、クラスタリングアルゴリズムの中心となる要素です。以下に、scikit-learnを使ったK-meansクラスタリングのコード例を示します。

import numpy as np

from sklearn.cluster import KMeans

data = np.array([

[1, 2],

[3, 4],

[5, 6],

[7, 8],

[9, 10]

])

kmeans = KMeans(n_clusters=2)

kmeans.fit(data)

labels = kmeans.labels_

print("Cluster labels:", labels)

実行結果:

Cluster labels: [0 0 0 1 1]

k-NN法による分類問題での距離計算

k-NN法は、最も近いk個のデータのラベルを基に、新しいデータのラベルを予測する分類手法です。距離計算がこの手法の中心にあります。以下に、scikit-learnを使ったk-NN法のコード例を示します。

import numpy as np

from sklearn.neighbors import KNeighborsClassifier

X_train = np.array([

[1, 2],

[3, 4],

[5, 6],

[7, 8],

[9, 10]

])

y_train = np.array([0, 0, 1, 1, 1])

knn = KNeighborsClassifier(n_neighbors=3)

knn.fit(X_train, y_train)

X_test = np.array([[2, 3], [6, 7]])

y_pred = knn.predict(X_test)

print("Predicted labels:", y_pred)

実行結果:

Predicted labels: [0 1]

まとめ

本記事では、numpyを使った距離計算の基本から、numpyと他のライブラリを組み合わせた応用例までを解説しました。距離計算は機械学習やデータ解析の分野で重要な役割を果たしており、numpyを使うことで効率的に計算を行うことができます。ぜひ、実際にコードを試してみて、numpyを使った距離計算の方法を身につけてください。

![[Python]Pandasを使って散布図を描画する方法:実践ガイド](https://machine-learning-skill-up.com/knowledge/wp-content/uploads/2023/10/1-11.jpg)